RSI-王亦安

2017-7-14

安装windows10 操作系统 安装Python, Anaconda, Notepad等软件 尝试解决数字识别问题。中途因为各种原因失败了很多次,后来在老师的帮助下重新安装了Python,最终成功了,虽然还不是很清楚原理。 继续探索。

2017-7-15

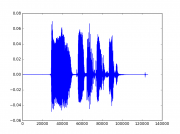

学习了关于机器识别的一些原理性知识。 录制了24条语音指令。通过convent_file文件将原来的m4a格式转换成了wav格式。然后通过ipython及相应的代码做出音频文件相应的波形图。如下图所示。

从gitlab上下载了audioNet文件,开始训练语音识别。一开始没有发现data中有很多(编号大于10000的)无效文件,后来经指点后发现,删除了它们。运行.py文件时要注意一定要在相应的目录下运行。 “cd” change director “cd \ ” 返回根目录 “cd..” 返回上一级目录 “↑ ” 复制粘贴上一次的命令

修改Python文件后,control S 可保存修改。

2017-7-16

经过晚上和上午的运行,成功训练了40个epoch,训练准确率已经达到99%,测试准确率达到95%。之后通过Android Studio在安卓系统的平板上安装了App。 具体步骤如下:在Gitlab中下载androidAudioRecg,在Android Studio中打开AudioSpeechRecognition.java,先生成.apk文件,然后run,就可以在平板上安装了。(注意,要将平板调成开发者模式,具体为:设置-关于平板电脑-版本号点击多次,然后在开发人员选项中打开USB调试)。 安装后进行测试,发现测试效果不是很好,“关机”“开机”“上”“下”等经常识别不清。后来经学长提醒,发现忘记用自己做出的model生成pb文件,系统自动用了以前的,所以之前生成的APP并不是自己做的。后来纠正了错误,重新生成了APP,识别准确率相当不错。

以下是图片记录:

- IMG 6878

训练得到的模型

2017-7-17

根据《PYNQ入门指南》装配PYNQ版,一开始没成功,后来发现是因为没有把“REG"移到”USB"。 完成按键控制LED和录音及音频处理两个实践。在完成录音任务时出现了一点问题。播放的声音是系统自带的而不是自录的,经指点发现是由于pAudio.load的路径不对,和之前pAudio.save的不一致,改正后,完成了此任务。

下午运行usb_webcam.ipynb,一开始总是报错。(如图)

和周围的运行成功的学长对比了一下,没有发现任何区别,百思不得其解。加上老师不在,遂暂时放下开始阅读文献。后来经助教指点。可以在Terminal界面中查询各种设备的连接情况。(如图)

发现输入 ls /dev/v时并没有出现video,说明摄像头连接有问题。换了一个摄像头后,再输入ls /dev/v,就可以找到video0了,说明摄像头连接成功,程序也可以顺利运行了。

今天还犯了一个错误。因为重启计算机,进行中的语音指令训练被中断。重新开始后,虽然我记得把train.py里最后面的参数改为了81,即从第81个epoch(及最后训练出的一个模型)开始训练,但忘了按control+S保存,导致实际运行时还是从第4个模型开始训练的,正确率只有88%左右,还覆盖了之前的模型。好在在助教的帮助下及时纠正了错误,避免了更大的损失。